Site Web gratuit & Serveur Migration

Déployez des GPU NVIDIA H200 hautes performances

Exécutez des charges de travail d'IA exigeantes sur de puissants GPU NVIDIA H200 avec un déploiement rapide, infrastructures performantes, et un calcul cloud évolutif conçu pour les applications modernes d'apprentissage automatique.

- Optimisé pour l'IA & Charges de travail LLM

- Infrastructure GPU hautes performances

- Déploiement cloud évolutif

- Performances de calcul de niveau entreprise

À partir de

2,30 € par GPU / heure

Le bonheur de nos clients

Colonel est noté sur Google Avis

Colonel est noté sur Capterra

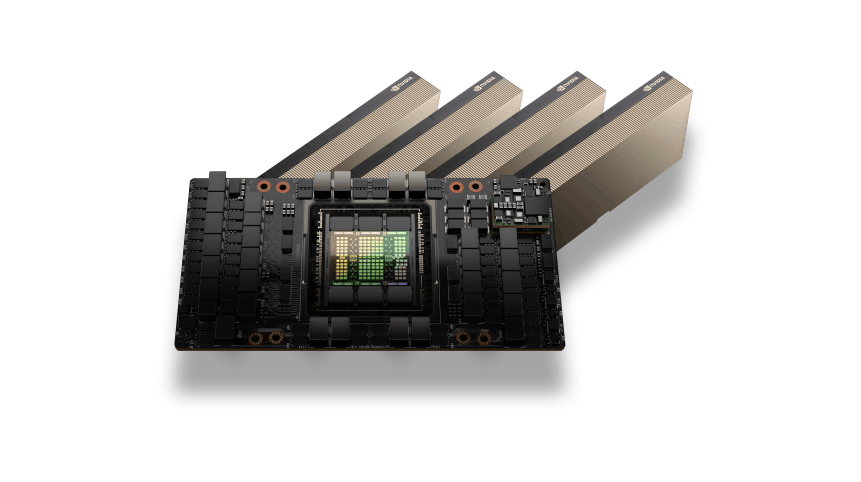

Architecture GPU NVIDIA H200

Le GPU NVIDIA H200 est construit sur l'architecture Hopper et offre des performances exceptionnelles pour les charges de travail d'IA modernes. Avec une capacité de mémoire HBM3e massive et une bande passante mémoire extrêmement élevée, Les GPU H200 sont conçus pour gérer de grands modèles de langage, formation en apprentissage profond, et tâches de calcul haute performance.

Performances de l'IA et du HPC

Les GPU NVIDIA H200 sont optimisés pour les environnements IA et HPC exigeants où de grands ensembles de données et des calculs complexes nécessitent une accélération puissante..

Qu'il s'agisse d'exécuter des pipelines de formation IA, Inférence LLM, ou simulations scientifiques, Les GPU H200 offrent les performances de calcul nécessaires pour traiter efficacement de grandes charges de travail tout en conservant une faible latence et une évolutivité élevée..

Cas d'utilisation des GPU NVIDIA H200

Formation sur les modèles d'IA

Entraînez des modèles de machine learning et de deep learning à grande échelle en utilisant la puissance de calcul massive des GPU NVIDIA H200.. Idéal pour la formation des modèles de transformateurs, réseaux de neurones, et de grands ensembles de données.

Inférence LLM

Déployer et exécuter de grands modèles de langage (LLM) tels que les modèles de style GPT, chatbots, et assistants IA avec inférence GPU hautes performances.

Calcul haute performance (HPC)

Accélérez les simulations scientifiques, charges de travail de recherche, et des tâches de calcul complexes qui nécessitent un traitement parallèle massif.

Traitement des données IA

Traiter et analyser de grands ensembles de données pour les pipelines d'IA, y compris le prétraitement, extraction de fonctionnalités, et analyse de données à grande échelle.

Rendu et simulation

Exécutez des charges de travail gourmandes en GPU telles que le rendu 3D, traitement vidéo, et des simulations physiques qui nécessitent un puissant calcul GPU parallèle.

Tarification flexible du GPU H200

GPU H200

Calcul GPU flexible à la demande pour la formation en IA, charges de travail d'inférence, et applications hautes performances.$2.30 par GPU / heure

Meilleur prixTop en vedette

Accélération du GPU NVIDIA H200

141Go de mémoire GPU HBM3e

Facturation horaire au fur et à mesure

Stockage NVMe hautes performances

Mise en réseau rapide de 10 à 100 Gbit/s

Idéal pour la formation et l'inférence en IA

Infrastructure cloud GPU évolutive

Déployer en quelques minutes

Optimisé pour les charges de travail LLM

Infrastructure GPU d'entreprise

Besoin d'une capacité GPU à grande échelle pour les clusters de formation d'IA ou les charges de travail d'entreprise?$ Tarification personnalisée

Pour les déploiements multi-GPU et les clusters dédiésTop en vedette

Clusters multi-GPU H200

Serveurs GPU dédiés

Processeur personnalisé, BÉLIER, et configurations de stockage

Infrastructure réseau GPU à haut débit

Conçu pour la formation en IA et les charges de travail HPC

Performances et fiabilité de niveau entreprise

Environnements de calcul IA évolutifs

Support technique prioritaire

Fonctionnalités d'entreprise des serveurs GPU NVIDIA H200

Performances extrêmes de formation en IA

Tirez parti de la puissance de calcul massive des GPU NVIDIA H200 pour former des modèles d'IA à grande échelle, réseaux de neurones profonds, et des charges de travail d'apprentissage automatique complexes avec une vitesse et une efficacité exceptionnelles.

Grande mémoire GPU HBM3e

Les GPU H200 fournissent une mémoire HBM3e haute capacité conçue pour les charges de travail d'IA exigeantes, grands modèles de langage, et pipelines de traitement de données hautes performances.

Optimisé pour les charges de travail LLM

Exécutez efficacement de grands modèles de langage modernes et des charges de travail d'inférence d'IA grâce à une architecture GPU optimisée pour les modèles de transformateur et les applications d'IA générative..

Infrastructure GPU haute vitesse

Nos serveurs GPU sont déployés sur une infrastructure hautes performances avec stockage NVMe et mise en réseau rapide, garantissant une faible latence et des performances de calcul maximales.

Déploiement GPU évolutif

Faites évoluer facilement votre environnement de calcul d'une instance GPU unique à des charges de travail multi-GPU en fonction de vos exigences de formation en IA ou d'inférence..

Cloud flexible ou déploiement dédié

Choisissez entre des instances GPU cloud à la demande pour des charges de travail flexibles ou des serveurs GPU dédiés pour une formation à l'IA de longue durée et des déploiements en entreprise.

Besoin d'aide pour choisir la bonne infrastructure GPU?

Questions fréquemment posées sur le serveur GPU

Trouvez des réponses aux questions courantes sur les serveurs GPU NVIDIA H200, options de déploiement, prix, et capacités de charge de travail de l'IA.

Chat en direct

24/7/365 Grâce au Chat Widget, important si vous exécutez.

Notre infrastructure Object Storage est hébergée dans des datacenters européens performants. Cela garantit une faible latence, normes strictes en matière de protection des données, et une conformité totale avec la réglementation RGPD. Des emplacements supplémentaires pourraient être ajoutés à l'avenir à mesure que la plateforme se développe.

Téléchargement de données vers Object Storage (trafic entrant) est totalement gratuit. Vous pouvez télécharger des fichiers, sauvegardes, ou des données d'application sans frais de transfert.

Le quota mensuel inclus inclut également le trafic sortant. Le trafic sortant supplémentaire au-delà du montant inclus est facturé séparément.

Non. Le quota de stockage et de trafic inclus s'applique au utilisation totale dans tous les compartiments de votre compte, pas par seau.

Vous pouvez créer plusieurs compartiments et répartir vos données entre eux tout en utilisant le même quota partagé..

L'utilisation du stockage est calculée à l'aide de To-heures (TB-h). Cette méthode mesure à la fois la quantité de données stockées et la durée pendant laquelle elles restent stockées.

Notre service de stockage d'objets est entièrement Compatible S3, ce qui signifie qu'il fonctionne avec une large gamme d'outils et de SDK existants.

Vous pouvez gérer des buckets, télécharger des fichiers, et contrôler les autorisations à l'aide d'outils tels que:

-

AWS CLI

-

rclone

-

SDK compatibles S3

-

Logiciel de sauvegarde prenant en charge les API S3

Cela permet une intégration facile avec les flux de travail et les applications existants.

Trafic entrant (téléchargements) est gratuit.

Le trafic sortant au-delà du quota inclus est facturé à $1.20 pour la tuberculose. Cela le rend adapté aux sauvegardes, stockage d'applications, et des charges de travail de données évolutives.

Object Storage est conçu pour les charges de travail de données évolutives et est couramment utilisé pour:

-

Sauvegarde et reprise après sinistre

-

Stockage multimédia (photos, vidéos, actifs)

-

Fichiers de sites Web statiques

-

Stockage des données des applications

-

Stockage des journaux et des archives

Il est idéal pour gérer de grandes quantités de données non structurées.

Vous pouvez créer plusieurs compartiments dans votre compte Object Storage pour organiser vos données. Les compartiments vous permettent de séparer les projets, candidatures, ou environnements tout en gérant tout sous le même quota de stockage.

Oui. Notre plateforme Object Storage utilise une infrastructure de stockage redondante pour protéger vos données contre les pannes matérielles.. Les données sont stockées sur plusieurs nœuds de stockage pour garantir la durabilité et la haute disponibilité. Cette redondance permet d'éviter la perte de données et de maintenir vos fichiers accessibles même en cas de panne d'un composant matériel..

Oui. Notre stockage d'objets est entièrement Compatible S3, ce qui signifie qu'il prend en charge la même structure API utilisée par Amazon S3. Cela vous permet d'utiliser des outils et des intégrations existants tels que AWS CLI, rclone, logiciel de sauvegarde, et SDK S3 sans modifier votre flux de travail.