Kostenlose Website & Server Migration

Stellen Sie leistungsstarke NVIDIA A40-GPUs bereit

Führen Sie leistungsstarke NVIDIA A40-GPU-Server für das KI-Training aus, Rendering von Arbeitslasten, maschinelles Lernen, und Hochleistungsrechnen mit skalierbarer Cloud- oder dedizierter GPU-Infrastruktur.

- Optimiert für KI & LLM-Workloads

- Hochleistungs-GPU-Infrastruktur

- Skalierbare Cloud-Bereitstellung

- Rechenleistung der Enterprise-Klasse

Beginnend bei

1,10 € pro GPU / Stunde

Unsere Kundenzufriedenheit

Oberst bewertet wird auf Google Review

Oberst bewertet wird auf Capterra

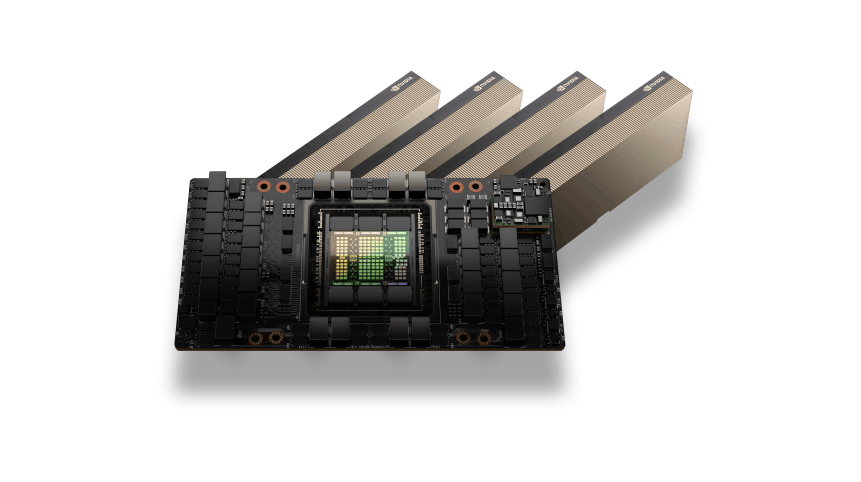

NVIDIA A40 GPU-Architektur

Die NVIDIA A40-GPU basiert auf der Ampere-Architektur und ist darauf ausgelegt, moderne KI-Workloads zu beschleunigen, Grafik-Rendering, und Rechenzentrumsanwendungen. Mit leistungsstarken Tensor-Kernen und großer GPU-Speicherkapazität, A40-GPUs liefern zuverlässige Leistung für maschinelles Lerntraining, Schlussfolgerung, und erweiterte Visualisierungs-Workloads.

Diese GPU wird häufig in Rechenzentren zur Unterstützung von Deep Learning eingesetzt, virtuelle Arbeitsplätze, und umfangreiche Datenverarbeitungsaufgaben bei gleichzeitig hoher Effizienz und Stabilität.

KI, Rendering und HPC-Leistung

NVIDIA A40-GPUs bieten eine starke Beschleunigung für KI-Workloads, Deep-Learning-Pipelines, und Hochleistungsrechnerumgebungen. Mit hoher Speicherkapazität und optimierter GPU-Architektur, Der A40 ermöglicht die effiziente Verarbeitung komplexer maschineller Lernmodelle und großer Datensätze.

Es ist auch sehr effektiv für das GPU-Rendering, Simulationsumgebungen, und professionelle Visualisierungs-Workloads, Dadurch eignet es sich für die KI-Infrastruktur von Unternehmen und die Kreativbranche.

Anwendungsfälle für NVIDIA A40-GPUs

KI-Modelltraining

Trainieren Sie Modelle für maschinelles Lernen und Deep Learning mithilfe der leistungsstarken Rechenfunktionen der NVIDIA A40-GPUs.

GPU-Rendering-Workloads

Beschleunigen Sie das 3D-Rendering, Animationsproduktion, und visuelle Effektverarbeitung.

Virtuelle Arbeitsplätze

Stellen Sie GPU-gestützte virtuelle Desktops und Remote-Workstations für das Design bereit, Maschinenbau, und Visualisierung.

Datenwissenschaft und Analytik

Verarbeiten Sie große Datensätze und Pipelines für maschinelles Lernen effizient.

Wissenschaftliche und technische Simulationen

Führen Sie Simulationen durch, Modellierungsaufgaben, und komplexe Rechenlasten.

Flexible A40-GPU-Preise

A40-GPU

Flexible On-Demand-GPU-Rechenleistung für das KI-Training, Rendering von Arbeitslasten, und Hochleistungsanwendungen.$1.10 pro GPU / Stunde

Bester PreisTop vorgestellt

NVIDIA A40 GPU-Beschleunigung

48GB GDDR6 GPU-Speicher

Stündliche Pay-as-you-go-GPU-Abrechnung

Hochleistungs-NVMe-Speicher

Schnelles Netzwerk mit 10–100 Gbit/s

Ideal für KI-Training und Rendering-Workloads

Skalierbare GPU-Cloud-Infrastruktur

Stellen Sie GPU-Instanzen innerhalb von Minuten bereit

Optimiert für Pipelines für maschinelles Lernen

GPU-Infrastruktur für Unternehmen

Benötigen Sie große GPU-Kapazität für KI-Trainingscluster oder Unternehmens-Workloads?$ Individuelle Preise

Für Multi-GPU-Bereitstellungen und dedizierte ClusterTop vorgestellt

Multi-GPU-Cluster

Dedizierte GPU-Server

Benutzerdefinierte CPU, RAM, und Speicherkonfigurationen

Hochgeschwindigkeits-GPU-Netzwerkinfrastruktur

Entwickelt für KI-Schulungen und HPC-Workloads

Leistung und Zuverlässigkeit auf Unternehmensniveau

Skalierbare KI-Rechenumgebungen

Vorrangiger technischer Support

Unternehmensfunktionen von NVIDIA A40 GPU-Servern

Beschleunigung der Ampere-Architektur

NVIDIA A40-GPUs basieren auf der Ampere-Architektur, die für KI- und professionelle Computer-Workloads entwickelt wurde.

Große GPU-Speicherkapazität

Der GPU-Speicher mit hoher Kapazität ermöglicht die effiziente Verarbeitung komplexer KI-Modelle und großer Datensätze.

Optimiert für KI und Visualisierung

Ideal für Deep-Learning-Workloads, datenwissenschaftliche Anwendungen, und professionelle Rendering-Aufgaben.

Hochgeschwindigkeits-GPU-Infrastruktur

GPU-Server laufen auf einer leistungsstarken Infrastruktur mit NVMe-Speicher und schneller Netzwerkanbindung.

Skalierbare GPU-Bereitstellung

Skalieren Sie Ihre Rechenumgebung von einer einzelnen GPU-Instanz bis hin zu großen GPU-Clustern.

Flexible Cloud- oder dedizierte Bereitstellung

Wählen Sie je nach Arbeitslastanforderungen zwischen Cloud-GPU-Instanzen oder dedizierten GPU-Servern.

Benötigen Sie Hilfe bei der Auswahl der richtigen GPU-Infrastruktur??

Häufig gestellte Fragen zum GPU-Server

Finden Sie Antworten auf häufig gestellte Fragen zu NVIDIA A40 GPU-Servern, Bereitstellungsoptionen, Preisgestaltung, und KI-Workload-Funktionen.

Live-Chat

24/7/365 Durch das Chat-Widget wichtig, wenn Sie laufen.

Das NVIDIA A40-GPU-Hosting ist für KI-Inferenz konzipiert, Entwicklung maschinellen Lernens, Hochleistungsrechnen, und professionelle GPU-Workloads. Es wird häufig von Entwicklern und Datenwissenschaftlern verwendet, die eine zuverlässige GPU-Beschleunigung für das Training von Modellen benötigen, Datenverarbeitung, und fortgeschrittene Rechenaufgaben.

Ja. Die NVIDIA A40-GPU eignet sich gut für Pipelines für maschinelles Lernen und KI-Inferenz-Workloads. Seine große VRAM-Kapazität und starke Parallelverarbeitungsleistung machen es effektiv für die Ausführung trainierter Modelle in Produktionsumgebungen und die Verarbeitung großer Datensätze.

Die NVIDIA A40-GPU beinhaltet 48GB GDDR6-Speicher, Dadurch können große KI-Modelle ausgeführt werden, Deep-Learning-Frameworks, und Hochleistungs-Computing-Workloads, die eine erhebliche GPU-Speicherkapazität erfordern.

Ja. NVIDIA A40 GPU-Server unterstützen vollständig moderne KI- und Machine-Learning-Frameworks, einschließlich PyTorch, TensorFlow, CUDA-Anwendungen, und andere GPU-beschleunigte Softwaretools, die für die KI-Entwicklung und Modellbereitstellung verwendet werden.

NVIDIA A40-GPU-Server werden häufig für KI-Inferenz verwendet, Experimente zum maschinellen Lernen, Deep-Learning-Entwicklung, Computer-Vision-Modelle, Datenanalyse, und GPU-beschleunigte Rendering-Workloads.

Colonelserver bietet eine zuverlässige GPU-Hosting-Infrastruktur mit leistungsstarkem Netzwerk, skalierbare Rechenressourcen, und stabile GPU-Umgebungen, die für KI-Entwickler entwickelt wurden, Datenwissenschaftler, und Unternehmen, die GPU-beschleunigte Anwendungen ausführen.