Kostenlose Website & Server Migration

Stellen Sie leistungsstarke NVIDIA B200-GPUs bereit

Führen Sie NVIDIA B200-GPU-Server der nächsten Generation für umfangreiches KI-Training aus, generative KI-Workloads, und Hochleistungsrechnen mit skalierbarer Cloud- oder dedizierter GPU-Infrastruktur.

- Optimiert für KI & LLM-Workloads

- Hochleistungs-GPU-Infrastruktur

- Skalierbare Cloud-Bereitstellung

- Rechenleistung der Enterprise-Klasse

Beginnend bei

5,2 € pro GPU / Stunde

Unsere Kundenzufriedenheit

Oberst bewertet wird auf Google Review

Oberst bewertet wird auf Capterra

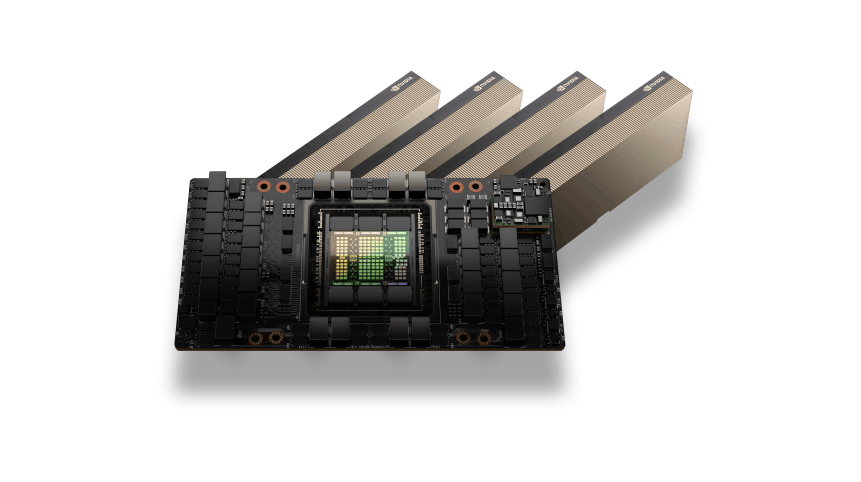

NVIDIA B200 GPU-Architektur

Die NVIDIA B200-GPU basiert auf der neuesten Blackwell-Architektur und liefert außergewöhnliche Rechenleistung für moderne KI-Infrastrukturen. Mit ultrahoher Speicherbandbreite und fortschrittlichen Tensorkernen, B200-GPUs sind für die Beschleunigung großer KI-Modelle konzipiert, Deep-Learning-Training, und datenintensive Arbeitslasten.

Diese Architektur ermöglicht ein schnelleres Modelltraining, verbesserte Effizienz, und optimierte Leistung für generative KI-Plattformen, große Sprachmodelle, und KI-Bereitstellungen in Unternehmen.

KI- und HPC-Leistung

NVIDIA B200-GPUs sind für die anspruchsvollsten KI- und Hochleistungs-Computing-Workloads optimiert. Vom Training großer Sprachmodelle bis hin zur Ausführung komplexer Datenpipelines und Simulationen, B200-GPUs bieten enorme parallele Rechenleistung und eine skalierbare Infrastruktur.

Ob für die KI-Forschung verwendet, KI-Plattformen für Unternehmen, oder fortschrittliche Pipelines für maschinelles Lernen, B200-GPUs liefern einen hohen Durchsatz, geringe Latenz, und effiziente Leistung für moderne Rechenumgebungen.

Anwendungsfälle für NVIDIA B200-GPUs

Großes Sprachmodelltraining

Trainieren Sie Transformatormodelle der nächsten Generation und große Sprachmodelle mit leistungsstarker GPU-Beschleunigung und enormer Rechenkapazität.

Generative KI-Plattformen

Führen Sie generative KI-Anwendungen wie die Bildgenerierung aus, Video-KI, und KI-Assistenten mit leistungsstarker GPU-Infrastruktur.

KI-Forschung und -Entwicklung

Entwickeln und testen Sie fortschrittliche KI-Architekturen, Deep-Learning-Modelle, und experimentelle maschinelle Lernsysteme.

Wissenschaftliches Rechnen

Beschleunigen Sie komplexe wissenschaftliche Simulationen, Ingenieursarbeitsbelastungen, und umfangreiche Datenmodellierungsaufgaben.

Hochleistungsdatenverarbeitung

Verarbeiten Sie riesige Datensätze und Pipelines für maschinelles Lernen für Unternehmensanalysen und KI-Anwendungen.

Flexible B200-GPU-Preise

B200-GPU

NVIDIA B200 GPU-Rechner der nächsten Generation, entwickelt für umfangreiches KI-Training, generative KI-Workloads, und Hochleistungsrechnerumgebungen.$5.2 pro GPU / Stunde

0,09 € pro 10 GBTop vorgestellt

Beschleunigung der NVIDIA B200 Blackwell-Architektur

Bis zu 192 GB HBM3e-GPU-Speicher mit ultrahoher Bandbreite

Stündliche Pay-as-you-go-GPU-Abrechnung

Hochleistungs-NVMe-Speicher

Ultraschnelles 100-Gbit/s-Netzwerk

Entwickelt für das Training großer KI-Modelle

Skalierbare Multi-GPU-KI-Infrastruktur

Stellen Sie GPU-Server innerhalb von Minuten bereit

Optimiert für generative KI- und LLM-Workloads

GPU-Infrastruktur für Unternehmen

Benötigen Sie große GPU-Kapazität für KI-Trainingscluster oder Unternehmens-Workloads?$ Individuelle Preise

Für Multi-GPU-Bereitstellungen und dedizierte ClusterTop vorgestellt

Multi-GPU-Cluster

Dedizierte GPU-Server

Benutzerdefinierte CPU, RAM, und Speicherkonfigurationen

Hochgeschwindigkeits-GPU-Netzwerkinfrastruktur

Entwickelt für KI-Schulungen und HPC-Workloads

Leistung und Zuverlässigkeit auf Unternehmensniveau

Skalierbare KI-Rechenumgebungen

Vorrangiger technischer Support

Unternehmensfunktionen von NVIDIA B200 GPU-Servern

Blackwell GPU-Architektur

GPU-Architektur der nächsten Generation, optimiert für große KI-Infrastruktur und erweiterte Rechenlasten.

Riesige GPU-Speicherbandbreite

Speicher mit hoher Bandbreite für die Verarbeitung großer Datensätze und das effiziente Training komplexer KI-Modelle.

Optimiert für generative KI

Ideal zum Trainieren und Ausführen moderner generativer KI-Modelle, einschließlich LLMs und transformatorbasierter Architekturen.

Hochgeschwindigkeits-GPU-Infrastruktur

GPU-Server, die auf einer Hochleistungsinfrastruktur mit NVMe-Speicher und schnellem Netzwerk bereitgestellt werden.

Skalierbare Multi-GPU-Umgebungen

Einfache Skalierung von einzelnen GPU-Instanzen bis hin zu großen Multi-GPU-Clustern für KI-Workloads in Unternehmen.

Flexible Cloud- oder dedizierte Bereitstellung

Stellen Sie B200-GPUs je nach Ihren Infrastrukturanforderungen als Cloud-GPU-Instanzen oder dedizierte GPU-Server bereit.

Benötigen Sie Hilfe bei der Auswahl der richtigen GPU-Infrastruktur??

Häufig gestellte Fragen zum GPU-Server

Finden Sie Antworten auf häufig gestellte Fragen zu NVIDIA B200 GPU-Servern, Bereitstellungsoptionen, Preisgestaltung, und KI-Workload-Funktionen.

Live-Chat

24/7/365 Durch das Chat-Widget wichtig, wenn Sie laufen.

NVIDIA B200 GPU-Hosting bietet eine leistungsstarke Recheninfrastruktur auf Basis der NVIDIA Blackwell-Architektur. Es ist für fortgeschrittenes KI-Training konzipiert, großräumige Schlussfolgerung, Deep-Learning-Modelle, und KI-Workloads für Unternehmen, die enorme parallele Rechenleistung erfordern.

Die NVIDIA B200-GPU ist für KI-Computing der nächsten Generation konzipiert. Es wird häufig zum Trainieren großer Sprachmodelle verwendet, generative KI-Systeme, Deep-Learning-Forschung, Wissenschaftliche Simulationen, und große Datenverarbeitungsumgebungen.

Ja. NVIDIA B200 ist speziell für das Training extrem großer KI-Modelle und Basismodelle optimiert. Seine fortschrittliche Architektur und hohe Speicherbandbreite ermöglichen schnellere Trainingszyklen für Transformatormodelle, LLMs, und andere anspruchsvolle maschinelle Lernaufgaben.

NVIDIA B200 GPU-Hosting bietet außergewöhnliche Rechenleistung, schnelleres KI-Modelltraining, hohe Skalierbarkeit, und Zuverlässigkeit auf Unternehmensniveau. Es ist eine ideale Lösung für Unternehmen, die eine leistungsstarke GPU-Infrastruktur für Workloads im Bereich künstliche Intelligenz und Datenwissenschaft benötigen.

NVIDIA B200 GPU-Server sind ideal für KI-Startups, Forschungslabore, Ingenieure für maschinelles Lernen, große Unternehmen, und Technologieunternehmen, die fortschrittliche KI-Systeme wie generative Modelle entwickeln, Empfehlungsmaschinen, und große Analyseplattformen.

Ja. NVIDIA B200 GPU-Hosting unterstützt moderne KI-Frameworks wie PyTorch, TensorFlow, CUDA-basierte Anwendungen, und andere GPU-beschleunigte Tools für maschinelles Lernen, Dadurch können Entwickler KI-Modelle effizient trainieren und einsetzen.

Ja. NVIDIA B200-GPUs wurden entwickelt, um generative KI und große Sprachmodelle zu beschleunigen. Sie werden häufig für das Training und die Durchführung von LLMs verwendet, Chatbots, multimodale KI-Systeme, und andere fortschrittliche KI-Anwendungen.

Dediziertes NVIDIA B200-Hosting bietet exklusiven GPU-Zugriff, vorhersehbare Leistung, volle Kontrolle über die Softwareumgebung, und verbesserte Stabilität für lang andauernde KI-Trainingsaufgaben und Produktions-Workloads.

Im Vergleich zu reinen CPU-Servern, NVIDIA B200-GPUs bieten eine deutlich schnellere Verarbeitung für KI-Workloads und parallele Rechenaufgaben. Dies verkürzt die Trainingszeiten erheblich und verbessert die Leistung für Deep Learning und datenintensive Anwendungen.

Colonelserver bietet eine leistungsstarke GPU-Infrastruktur, zuverlässige Netzwerkkonnektivität, und skalierbare GPU-Hosting-Lösungen für KI-Entwickler, Datenwissenschaftler, und Unternehmen, die leistungsstarke und stabile GPU-Rechenressourcen benötigen.