Kostenlose Website & Server Migration

Stellen Sie leistungsstarke NVIDIA H200-GPUs bereit

Führen Sie anspruchsvolle KI-Workloads auf leistungsstarken NVIDIA H200-GPUs mit schneller Bereitstellung aus, Hochleistungsinfrastruktur, und skalierbares Cloud-Computing, das für moderne maschinelle Lernanwendungen entwickelt wurde.

- Optimiert für KI & LLM-Workloads

- Hochleistungs-GPU-Infrastruktur

- Skalierbare Cloud-Bereitstellung

- Rechenleistung der Enterprise-Klasse

Beginnend bei

2,30 € pro GPU / Stunde

Unsere Kundenzufriedenheit

Oberst bewertet wird auf Google Review

Oberst bewertet wird auf Capterra

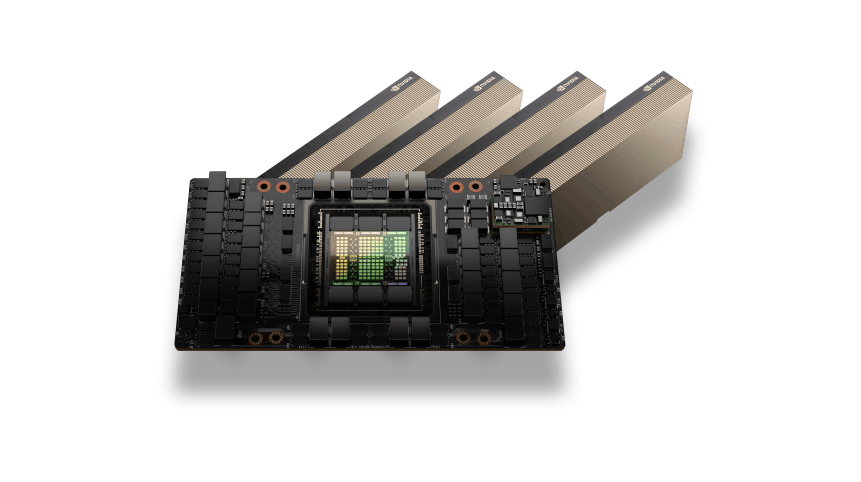

NVIDIA H200 GPU-Architektur

Die NVIDIA H200 GPU basiert auf der Hopper-Architektur und liefert außergewöhnliche Leistung für moderne KI-Workloads. Mit enormer HBM3e-Speicherkapazität und extrem hoher Speicherbandbreite, H200-GPUs sind für die Verarbeitung großer Sprachmodelle ausgelegt, Deep-Learning-Training, und Hochleistungsrechneraufgaben.

KI- und HPC-Leistung

NVIDIA H200-GPUs sind für anspruchsvolle KI- und HPC-Umgebungen optimiert, in denen große Datensätze und komplexe Berechnungen eine leistungsstarke Beschleunigung erfordern.

Ob Sie KI-Trainingspipelines betreiben, LLM-Schlussfolgerung, oder wissenschaftliche Simulationen, H200-GPUs bieten die erforderliche Rechenleistung, um große Arbeitslasten effizient zu verarbeiten und gleichzeitig eine geringe Latenz und hohe Skalierbarkeit aufrechtzuerhalten.

Anwendungsfälle für NVIDIA H200-GPUs

KI-Modelltraining

Trainieren Sie groß angelegte Modelle für maschinelles Lernen und Deep Learning mit der enormen Rechenleistung der NVIDIA H200-GPUs. Ideal zum Trainieren von Transformatormodellen, neuronale Netze, und große Datensätze.

LLM-Inferenz

Stellen Sie große Sprachmodelle bereit und führen Sie sie aus (LLMs) wie zum Beispiel Modelle im GPT-Stil, Chatbots, und KI-Assistenten mit leistungsstarker GPU-Inferenz.

Hochleistungsrechnen (HPC)

Beschleunigen Sie wissenschaftliche Simulationen, Forschungsarbeitsbelastungen, und komplexe Rechenaufgaben, die eine massive Parallelverarbeitung erfordern.

KI-Datenverarbeitung

Verarbeiten und analysieren Sie große Datensätze für KI-Pipelines, inklusive Vorverarbeitung, Merkmalsextraktion, und groß angelegte Datenanalysen.

Rendering und Simulation

Führen Sie GPU-intensive Arbeitslasten wie 3D-Rendering aus, Videoverarbeitung, und Physiksimulationen, die leistungsstarkes paralleles GPU-Computing erfordern.

Flexible H200-GPU-Preise

H200-GPU

Flexible On-Demand-GPU-Berechnung für KI-Training, Inferenz-Workloads, und Hochleistungsanwendungen.$2.30 pro GPU / Stunde

Bester PreisTop vorgestellt

NVIDIA H200 GPU-Beschleunigung

141GB HBM3e GPU-Speicher

Stündliche Pay-as-you-go-Abrechnung

Hochleistungs-NVMe-Speicher

Schnelles Netzwerk mit 10–100 Gbit/s

Ideal für KI-Training und Inferenz

Skalierbare GPU-Cloud-Infrastruktur

Bereitstellung innerhalb weniger Minuten

Optimiert für LLM-Workloads

GPU-Infrastruktur für Unternehmen

Benötigen Sie große GPU-Kapazität für KI-Trainingscluster oder Unternehmens-Workloads?$ Individuelle Preise

Für Multi-GPU-Bereitstellungen und dedizierte ClusterTop vorgestellt

Multi-GPU-H200-Cluster

Dedizierte GPU-Server

Benutzerdefinierte CPU, RAM, und Speicherkonfigurationen

Hochgeschwindigkeits-GPU-Netzwerkinfrastruktur

Entwickelt für KI-Schulungen und HPC-Workloads

Leistung und Zuverlässigkeit auf Unternehmensniveau

Skalierbare KI-Rechenumgebungen

Vorrangiger technischer Support

Unternehmensfunktionen von NVIDIA H200 GPU-Servern

Extreme KI-Trainingsleistung

Nutzen Sie die enorme Rechenleistung der NVIDIA H200-GPUs, um umfangreiche KI-Modelle zu trainieren, tiefe neuronale Netze, und komplexe maschinelle Lernaufgaben mit außergewöhnlicher Geschwindigkeit und Effizienz.

Großer HBM3e-GPU-Speicher

H200-GPUs bieten HBM3e-Speicher mit hoher Kapazität, der für anspruchsvolle KI-Workloads ausgelegt ist, große Sprachmodelle, und leistungsstarke Datenverarbeitungspipelines.

Optimiert für LLM-Workloads

Führen Sie moderne große Sprachmodelle und KI-Inferenz-Workloads effizient mit einer GPU-Architektur aus, die für Transformatormodelle und generative KI-Anwendungen optimiert ist.

Hochgeschwindigkeits-GPU-Infrastruktur

Unsere GPU-Server werden auf einer leistungsstarken Infrastruktur mit NVMe-Speicher und schneller Netzwerkanbindung bereitgestellt, Gewährleistung geringer Latenz und maximaler Rechenleistung.

Skalierbare GPU-Bereitstellung

Skalieren Sie Ihre Rechenumgebung ganz einfach von einer einzelnen GPU-Instanz auf Workloads mit mehreren GPUs, abhängig von Ihren KI-Trainings- oder Inferenzanforderungen.

Flexible Cloud- oder dedizierte Bereitstellung

Wählen Sie zwischen On-Demand-Cloud-GPU-Instanzen für flexible Arbeitslasten oder dedizierten GPU-Servern für lang laufende KI-Schulungen und Unternehmensbereitstellungen.

Benötigen Sie Hilfe bei der Auswahl der richtigen GPU-Infrastruktur??

Häufig gestellte Fragen zum GPU-Server

Finden Sie Antworten auf häufig gestellte Fragen zu NVIDIA H200 GPU-Servern, Bereitstellungsoptionen, Preisgestaltung, und KI-Workload-Funktionen.

Live-Chat

24/7/365 Durch das Chat-Widget wichtig, wenn Sie laufen.

Unsere Objektspeicher-Infrastruktur wird in leistungsstarken europäischen Rechenzentren gehostet. Dies gewährleistet eine geringe Latenz, strenge Datenschutzstandards, und vollständige Einhaltung der DSGVO-Vorschriften. Mit der Erweiterung der Plattform können in Zukunft weitere Standorte hinzugefügt werden.

Hochladen von Daten in Object Storage (Eingangsverkehr) ist völlig kostenlos. Sie können Dateien hochladen, Backups, oder Bewerbungsdaten ohne Übermittlungskosten.

Im enthaltenen monatlichen Kontingent ist auch der ausgehende Traffic enthalten. Zusätzlicher ausgehender Datenverkehr, der über den enthaltenen Betrag hinausgeht, wird separat in Rechnung gestellt.

NEIN. Das enthaltene Speicher- und Traffic-Kontingent gilt für Gesamtnutzung über alle Buckets in Ihrem Konto, nicht pro Eimer.

Sie können mehrere Buckets erstellen und Ihre Daten darauf verteilen, während Sie weiterhin dasselbe gemeinsame Kontingent verwenden.

Die Speichernutzung wird anhand berechnet TB-Stunden (TB-h). Diese Methode misst sowohl die Menge der gespeicherten Daten als auch die Dauer, in der sie gespeichert bleiben.

Unser Objektspeicherservice ist vollständig S3-kompatibel, Das bedeutet, dass es mit einer breiten Palette bestehender Tools und SDKs funktioniert.

Sie können Buckets verwalten, Dateien hochladen, und Kontrollberechtigungen mit Tools wie:

-

AWS CLI

-

rclone

-

S3-kompatible SDKs

-

Backup-Software, die S3-APIs unterstützt

Dies ermöglicht eine einfache Integration in bestehende Arbeitsabläufe und Anwendungen.

Eingehender Verkehr (Uploads) ist kostenlos.

Ausgehender Datenverkehr, der über das enthaltene Kontingent hinausgeht, wird mit abgerechnet $1.20 für TB. Dadurch eignet es sich für Backups, Anwendungsspeicher, und skalierbare Daten-Workloads.

Object Storage ist für skalierbare Daten-Workloads konzipiert und wird häufig für verwendet:

-

Backup und Disaster Recovery

-

Medienspeicher (Bilder, Videos, Vermögenswerte)

-

Statische Website-Dateien

-

Anwendungsdatenspeicherung

-

Protokoll- und Archivspeicher

Es ist ideal für den Umgang mit großen Mengen unstrukturierter Daten.

Sie können in Ihrem Object Storage-Konto mehrere Buckets erstellen, um Ihre Daten zu organisieren. Mit Buckets können Sie Projekte trennen, Anwendungen, oder Umgebungen, während alles mit demselben Speicherkontingent verwaltet wird.

Ja. Unsere Object Storage-Plattform nutzt eine redundante Speicherinfrastruktur, um Ihre Daten vor Hardwareausfällen zu schützen. Die Daten werden über mehrere Speicherknoten hinweg gespeichert, um Haltbarkeit und hohe Verfügbarkeit zu gewährleisten. Diese Redundanz hilft, Datenverluste zu verhindern und sorgt dafür, dass Ihre Dateien auch dann zugänglich bleiben, wenn eine Hardwarekomponente ausfällt.

Ja. Unser Objektspeicher ist vollständig S3-kompatibel, Das heißt, es unterstützt dieselbe API-Struktur, die von Amazon S3 verwendet wird. Dadurch können Sie vorhandene Tools und Integrationen nutzen, z AWS CLI, rclone, Backup-Software, und S3 SDKs ohne Ihren Arbeitsablauf zu ändern.