Implementeer krachtige NVIDIA H100 GPU's

ultrakrachtige NVIDIA H100 GPU-servers voor AI-training, grote taalmodellen, diep leren, en high-performance computing met schaalbare cloud- of speciale GPU-infrastructuur.

- Geoptimaliseerd voor AI & LLM-werklasten

- Hoogwaardige GPU-infrastructuur

- Schaalbare cloudimplementatie

- Computerprestaties op ondernemingsniveau

Beginnend om

€ 3,30 per GPU / uur

Ons klantengeluk

Kolonel wordt beoordeeld op Google Review

Kolonel wordt beoordeeld op Capterra

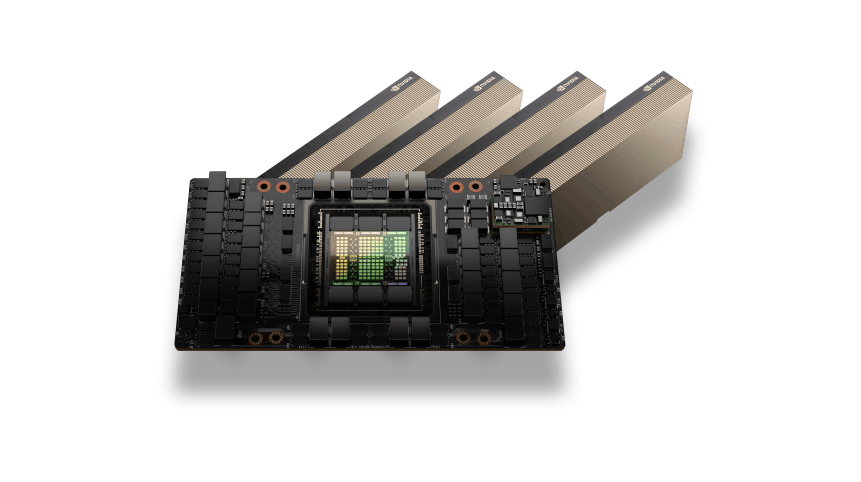

NVIDIA H100 GPU-architectuur

De NVIDIA H100 GPU is gebouwd op de Hopper-architectuur en is ontworpen om extreme prestaties te leveren voor de moderne AI-infrastructuur. Met geavanceerde Tensor Cores en geheugen met hoge bandbreedte, H100 GPU's versnellen grootschalige deep learning-workloads en complexe AI-trainingspijplijnen.

Deze architectuur maakt snellere modeltraining mogelijk, verbeterde efficiëntie voor transformatormodellen, en geoptimaliseerde prestaties voor grote taalmodellen en generatieve AI-toepassingen.

AI en grootschalige computerprestaties

NVIDIA H100 GPU's bieden uitzonderlijke rekenprestaties voor de meest veeleisende AI-workloads. Van het trainen van enorme neurale netwerken tot het uitvoeren van realtime gevolgtrekkingen voor grote taalmodellen, H100 GPU's maken een efficiënte verwerking van grote datasets en complexe machine learning-taken mogelijk.

Of het nu gaat om AI-onderzoek, zakelijke AI-infrastructuur, of grootschalige HPC-omgevingen, H100 GPU's leveren betrouwbare prestaties en schaalbare rekenkracht.

NVIDIA H100 GPU's gebruiksscenario's

Grote taalmodeltraining

Train geavanceerde transformatormodellen en grootschalige generatieve AI-systemen.

AI-inferentie op schaal

Voer krachtige inferentiepijplijnen uit voor chatbots, AI-assistenten, en LLM-aanvragen.

Computer met hoge prestaties

Versnel wetenschappelijk onderzoek, technische simulaties, en complexe rekentaken.

AI-onderzoek en -ontwikkeling

Ontwikkel AI-architecturen van de volgende generatie en experimentele machine learning-modellen.

Gegevensverwerking en analyse

Verwerk enorme datasets voor machine learning-pijplijnen en bedrijfsanalyseworkloads.

Flexibele H100 GPU-prijzen

H100-GPU

Enterprise-grade NVIDIA H100 GPU-computer ontworpen voor AI-training, grote taalmodellen, en krachtige computerwerklasten.$3.30 per GPU / uur

Beste prijsTop aanbevolen

NVIDIA H100 Tensor Core GPU-versnelling

80GB HBM3 GPU-geheugen met hoge bandbreedte

GPU-facturering op uurbasis, op basis van pay-as-you-go

Krachtige NVMe-opslag

Ultrasnelle 100Gbps-netwerken

Ideaal voor grote AI-modeltraining

Schaalbare GPU-cloudinfrastructuur

Implementeer GPU-instanties binnen enkele minuten

Geoptimaliseerd voor LLM en generatieve AI-workloads

Enterprise GPU-infrastructuur

Er is behoefte aan grootschalige GPU-capaciteit voor AI-trainingsclusters of bedrijfsworkloads?$ Aangepaste prijzen

Voor implementaties met meerdere GPU's en speciale clustersTop aanbevolen

Multi-GPU H00-clusters

Toegewijde GPU-servers

Aangepaste CPU, RAM, en opslagconfiguraties

Snelle GPU-netwerkinfrastructuur

Ontworpen voor AI-training en HPC-workloads

Prestaties en betrouwbaarheid op ondernemingsniveau

Schaalbare AI-computeromgevingen

Prioritaire technische ondersteuning

Enterprise-functies van NVIDIA H100 GPU-servers

Hopper GPU-architectuur

Gebouwd op NVIDIA Hopper-architectuur, geoptimaliseerd voor moderne AI-infrastructuur en geavanceerd computergebruik.

GPU-geheugen met hoge bandbreedte

Hoogwaardig GPU-geheugen ontworpen om grote datasets en complexe AI-modellen efficiënt te verwerken.

Geoptimaliseerd voor LLM-workloads

Ideaal voor grote taalmodellen, transformator architecturen, en generatieve AI-workloads.

Hoogwaardige GPU-infrastructuur

GPU-servers draaien op een snelle infrastructuur met NVMe-opslag en snel netwerken.

Schaalbare multi-GPU-omgevingen

Schaal van implementaties met één GPU tot grote clusters met meerdere GPU's voor zakelijke AI-workloads.

Flexibele cloud- of specifieke implementatie

Implementeer H100 GPU's als cloudinstances of speciale GPU-servers, afhankelijk van uw infrastructuurbehoeften.

Hulp nodig bij het kiezen van de juiste GPU-infrastructuur?

Veelgestelde vragen over GPU-server

Vind antwoorden op veelgestelde vragen over NVIDIA H100 GPU-servers, implementatie opties, prijzen, en AI-werklastmogelijkheden.

Livechat

24/7/365 Via de Chat Widget is het belangrijk als je rent.

NVIDIA H100 GPU-hosting biedt krachtige AI-infrastructuur, mogelijk gemaakt door de NVIDIA Hopper-architectuur. Het is ontworpen voor geavanceerd machinaal leren, grote taalmodellen, diepgaande leeropleiding, en krachtige computerworkloads die enorme GPU-versnelling vereisen.

Ja. De NVIDIA H100 GPU is een van de krachtigste GPU's die beschikbaar zijn voor AI-training. Het wordt veel gebruikt voor het trainen van grote taalmodellen, generatieve AI-systemen, en complexe deep learning-netwerken die hoge rekenprestaties en snelle geheugenbandbreedte vereisen.

De NVIDIA H100 GPU bevat doorgaans 80GB HBM3-geheugen, het bieden van extreem hoge bandbreedte en capaciteit. Hierdoor kan het zeer grote datasets en AI-modellen verwerken die worden gebruikt bij deep learning, wetenschappelijk computergebruik, en geavanceerde gegevensverwerking.

NVIDIA H100 GPU-servers worden vaak gebruikt voor AI-modeltraining, grote taalmodellen, generatieve AI, gegevensanalyse, wetenschappelijke simulaties, en krachtige computerworkloads die enorme parallelle verwerking vereisen.

Ja. NVIDIA H100 GPU-servers ondersteunen volledig moderne AI-frameworks zoals PyTorch, TensorFlow, CUDA-applicaties, en andere GPU-versnelde tools die worden gebruikt voor het trainen en inzetten van AI-modellen.

Colonelserver biedt een krachtige GPU-infrastructuur met krachtige netwerken en schaalbare computerbronnen. NVIDIA H100 GPU-servers zijn ontworpen voor AI-ingenieurs, data wetenschappers, en organisaties die veeleisende AI- en machine learning-workloads uitvoeren.